Evropská komise tento týden představila etické pokyny týkající se bezpečné umělé inteligence (ethics guidelines for trustworthy AI). Jde o výsledek práce skupiny odborníků na umělou inteligenci, kterou Komise sestavila v polovině loňského roku. Z Čechů v ní nikdo nezasedá, je v ní ale jedna Slovenka.

EU má zájem stát se jedním z hlavních hráčů v oblasti umělé inteligence, zároveň chce ale nastavit pravidla tak, aby tato AI nebyla případnou hrozbou. Etické pokyny navrhují, jak by se společně v této věci mělo postupovat a jak AI sladit s právem a regulacemi.

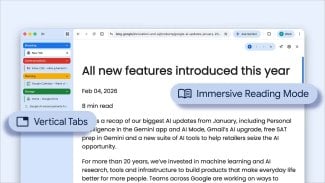

Etické pokyny se od letošního léta budou testovat v praxi (lze se připojit k The European AI Alliance) a Komise bude sbírat poznatky, které by pak měly být dále integrovány. Evropa pak bude hledat konsenzus s dalšími státy (Japonsko, Kanada, Singapur) a téma prosazovat na G7 či G20.

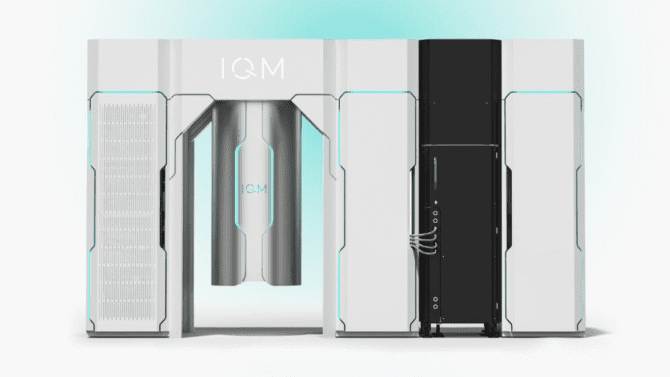

Součástí rozsáhlého evropského projektu je spuštění i takzvaných center excellence pro výzkum umělé inteligence. V Česku spouští půlmiliardový AI projekt například Výzkumné centrum informatiky ČVUT vedené Michalem Pěchoučkem. Příští týden bude také oficiálně spuštěn údajně nejvýkonnější cluster pro AI aplikace v Česku.

Kompletní zpráva od High-Level Expert Group je k dispozici zde (PDF). Etické pokyny Evropské komise mají těchto sedm základních podmínek:

- Možnost řízení a dohledu ze strany člověka: Systémy využívající umělou inteligenci by měly pomáhat vytvářet spravedlivou společnost podporou lidského faktoru a dodržováním základní práv, nikoliv lidskou nezávislost zmenšovat, omezovat nebo zavádějícím způsobem směrovat.

- Robustnost a bezpečnost: Důvěryhodná umělá inteligence musí být založena na bezpečných, spolehlivých a odolných algoritmech, které bude možné použít i v případě, že se vyskytnou chyby nebo bude systém nestabilní, a to během všech životních cyklů systému.

- Ochrana soukromí a dat: Občané by měli mít plnou kontrolu nad svými údaji a údaje o nich nesmí být použity k jejich újmě ani diskriminaci.

- Transparentnost: Systémy umělé inteligence musí být sledovatelné.

- Rozmanitost, zákaz diskriminace a rovné zacházení: Systémy umělé inteligence by měly zohledňovat celou škálu lidských schopností, dovedností a požadavků a měly by být přístupné všem.

- Společenský a environmentální prospěch: Systémy umělé inteligence by se měly využívat k podpoře pozitivních sociálních změn a ke zvýšení udržitelnosti a ekologické odpovědnosti.

- Odpovědnost: Měly by být zavedeny mechanismy, které zajistí odpovědnost za systémy umělé inteligence a za výsledky jejich činnosti.