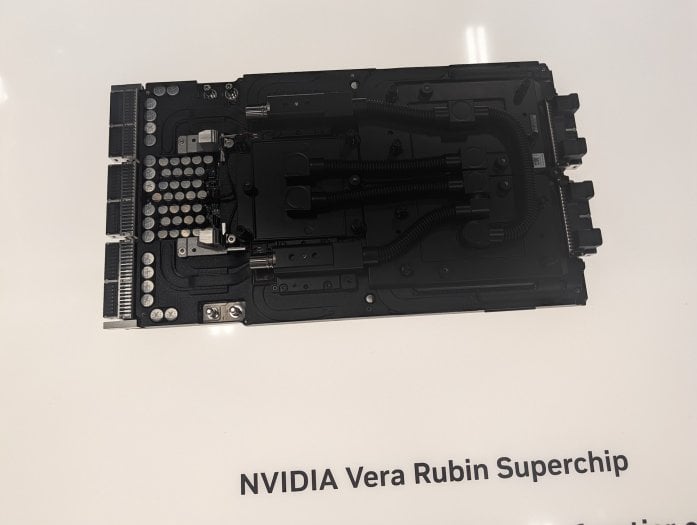

Nvidia by v druhé polovině roku měla začít dodávat novou generaci čipů pro umělou inteligenci. Půjde o následovníka aktuálního Blackwellu, konkrétně o grafické karty Rubin, procesory Vera (ARM) a jejich kombinaci Vera Rubin (takzvaný superčip). Mezi prvními odběrateli budou největší AI společnosti současnosti, kromě jiného Google. Nvidia na konferenci Google Cloud Next 2026 v Las Vegas ukázala první náznak toho, jak bude Vera Rubin vypadat. Podívat se můžete v naší galerii.

Nová generace Nvidie bude první, kterou zřejmě nepůjde chladit vzduchem, pouze kapalinou (45 stupňů Celsia). Opět výrazně vyroste cena. Například u Blackwellu byla cena jednoho standardizovaného racku (NVL72) tři až čtyři miliony dolarů, u Very Rubin půjde o pět až sedm milionů dolarů. Nvidia k tomu dodává, že až desetkrát klesne cena na generování tokenů, což se uvidí v praxi.

Část technologie kolem Very Rubin se týká i České republiky. Společnost Onsemi, která má výrobu v Rožnově pod Radhoštěm, dodává Nvidii napájecí čipy (power electronics).

Rack Vera Rubin NV72 bude obsahovat 72 grafických karet a 36 procesorů. Novinkou bude použití nejnovější generace pamětí HBM4, do jednoho rozvaděče půjde umístit 20,7 TB s propustností 1,6 PB/s. NVLink dosáhne na 260 TB/s.

Rubin GPU se vyrábí 3nm procesem TSMC (N3P) a obsahuje 336 miliard tranzistorů (Blackwell měl 208 miliard). Na jedno GPU bude až 288 GB HBM4, šířka pásma dosáhne 22 TB/s. NVLink zvládne oběma směry 3,6 TB/s na jedno GPU.

Vera CPU využije 88 jader ARM s označením Olympus, k dispozici bude takzvaný Spatial Multithreading se 176 vlákny. L2 cache bude mít dva MB na jádro, sdílená L3 cache dosáhne na 164 MB. Podpora pamětí bude LPDDR5X s propustností 1,2 TB/s. Integrován bude NVLink chip-to-chip s propustností 1,8 TB/s, což umožní rychlou komunikaci mezi CPU a GPU bez úzkého hrdla v podobě PCIe.

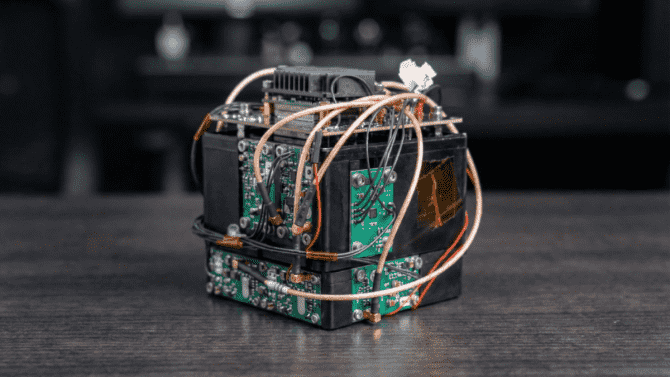

Nvidia v rámci nadcházející generace poprvé začlení technologii LPU od v podstatě koupené firmy Groq. Tyto čipy pro inferenci pracují s ultrarychlou pamětí SRAM, která má propustnost 150 TB/s, což je oproti HBM4 několikanásobek. Nevýhodou je objem, na čip půjde dát 500 MB SRAM a do jednoho racku se vejde 256 čipů s celkově 128 GB SRAM. Nvidia tuto technologii pozicuje na inferenci tam, kde jsou nutné co nejrychlejší výsledky a pro ty, kdo jsou ochotní za to zaplatit.

Google bude v cloudu nabízet instance A5X postavené na Vera Rubin NVL72. V jednom clusteru bude možné mít až 80 tisíc GPU a mezi více clustery až 960 tisíc GPU.

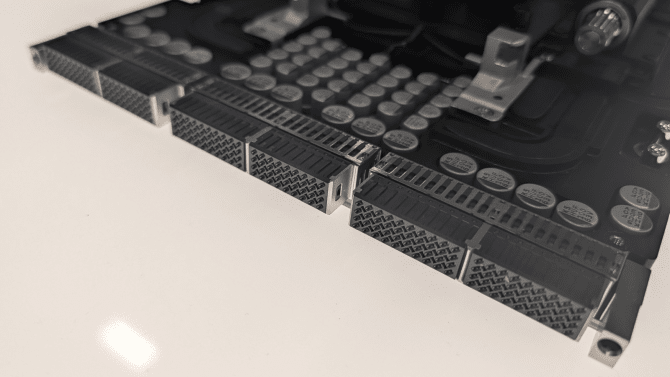

Google ve svém cloudu aktuálně provozuje Blackwelly. Takto vypadá rack s GB200 a GB300, který ve velkých počtech běží v jeho datacentrech. O specifikacích Blackwellů jsme více psali třeba zde.