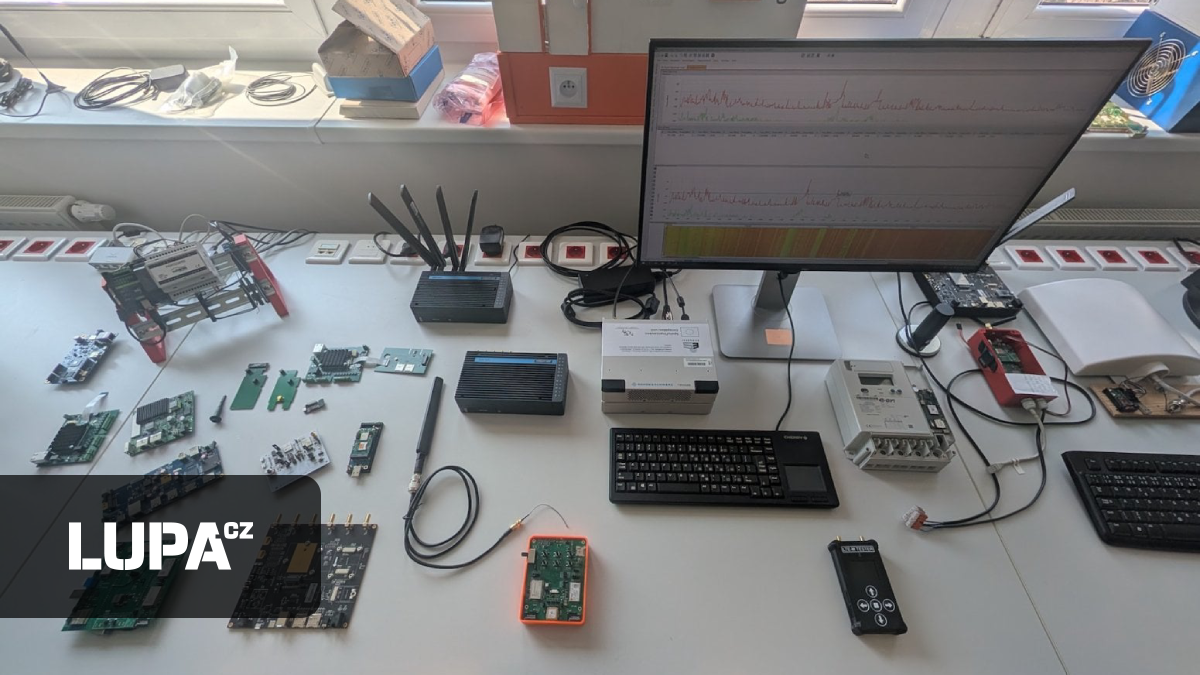

Graf, který ukazuje Václav Skála z české hostingové společnosti vshosting, vypadá jako kardiogram někoho v panice – neustálé výkyvy, server se pere se zátěží, která přichází ve vlnách. Jde o e-shop s průmyslovým vybavením se zákazníky z 18 zemí a jeho normální provoz. Jenže na webu se pohybuje chytrý robot. Když v jeden moment vshosting nasazuje ochranu, křivka se uklidňuje, provoz stabilizuje, web začne odpovídat rychleji.

Nebo jiný příběh: e-shop, který si ochranu v únoru naopak na vlastní žádost vypnul. Chtěl si ověřit, jestli ji skutečně potřebuje. Vytížení serveru okamžitě vyskočilo zpět. Než ochranu po dvanácti dnech firma znovu zapnula, server zpracovával naráz požadavky dvanácti CPU jader místo obvyklých pěti.

Útoky se můžou tvářit jako DDoS, ale podle dat vshostingu téměř polovina veškerého provozu, který na weby jeho klientů míří, tvoří požadavky, které na server vůbec nepatří. Z výzev zobrazených podezřelým přístupům se jen 0,55 % ukázalo jako skuteční lidé.

„Zkoušel jsem modelový příklad. Zeptal jsem se Perplexity, ať mi doporučí nějaký dárek s vymyšlenými parametry na jednoduchém e-shopu. Perplexity udělalo například 20 requestů zároveň na daný web, kdy prošlo různými kategoriemi a rozkliklo si různé produkty. Což ale reálně znamená, že zatímco legitimní uživatel by klikal stránku po stránce a vždy by si na té stránce něco přečetl, AI vytvoří 20 requestů zároveň,“ popisuje Skála.

Na takto jednoduchém webu čísla nevypadají příliš významně. „Ale když máme klienty, kteří na serveru mají například tisíc domén, a takový provoz se sejde na více domén zároveň, je možné, že jen takový provoz botů vyčerpá kompletní zdroje toho serveru,“ říká Skála.

Mezník, jak dlouho přesně se návštěvnost webů způsobená AI boty zvyšuje, není možné určit. Nárůsty jsou podle odborníků pozvolné a probíhají už několik let. Závod mezi poskytovateli AI modelů o to, kdo rychleji nasbírá data k trénování, pohyb botů, akceleroval. A během loňského roku se situace pro mnohé provozovatele webů stala podle Skály neúnosnou. Provoz od AI botů u některých serverů překročil legitimní návštěvnost.

„Podle meziroční statistiky trafficu, který měříme na síťových prvcích, jako jsou routery, vidíme, že meziročně jde o nárůst kolem 14,5 %,“ uvádí Skála průměrné číslo. Velkou část tohoto nárůstu netvoří lidé, ale stroje. „Často místo toho, aby nějaký klient přišel a prohlížel si stránku, pošle na ni bota, ChatGPT nebo jiné veřejné služby tohoto typu,“ vysvětluje obchodní ředitel vshostingu Marián Holý.

Problém je v tom, že boti se chovají zásadně jinak než lidé, což dostává servery pod tlak. „Nechodí podle nejčastějších stránek, ale najdou si celou stránku, a postupně přistupují na všechny odkazy v ní obsažené. Takže bot navštíví v rámci webu i různé zapadlé stránky, na které legitimní zákazníci nechodí. A ten web je musí vygenerovat, protože nejsou v cache,“ vysvětluje Skála.

Čím složitější web, čím víc produktových podstránek a vzájemných odkazů, tím víc se botům líbí. E-shopy s miliony produktových stránek jsou pro ně ideální cíl. „AI boti fungují tak, že je to v podstatě výrazně zrychlené lidské chování. To, co by člověk dělal v minutách, se v jejich případě děje v milisekundách. Bot prohledává a skenuje ten web tak, že ho zahltí svojí rychlostí,“ přirovnává.

Boti, co se tváří jako lidé

Podle Ondřeje Zapletala, senior analytika společnosti Etnetera Core, nárůst aktivity botů trvá už několik let. „Z crawlerů neboli automatizovaných programů, které za AI nástroje procházejí internet a sbírají obsah pro trénování modelů či generování odpovědí sloužících AI nástrojům, je nejaktivnější ten od firmy OpenAI, jež provozuje ChatGPT. U ostatních to buď nelze identifikovat, nebo je jejich aktivita relativně nízká. Například Google nerozlišuje mezi botem pro běžné vyhledávání a pro Gemini,“ popisuje.

Problémem jsou podle něj hlavně boti, kteří se neidentifikují nebo se snaží maskovat svůj původ. „A ti nutně nemusí souviset s AI nástroji,“ ujasňuje. Můžou ale vykazovat příliš velkou návštěvnost některých webů a přehlcení serveru, nebo se snažit prolomit zabezpečení a získat informace.

„Vidíme to v podstatě u všech našich e-commerce klientů, kterých jsou desítky. Jedná se přitom o lídry e-commerce trhu, nicméně zvýšený nápor se nevyhýbá ani běžným e-shopům,“ potvrzuje také Václav Svátek, generální ředitel ČMIS, společnosti, která zajišťuje mimo jiné hosting či správu IT.

„Jedná se o aktuální problém napříč celým trhem, který firmám přináší další nežádoucí zátěž,“ rozvádí s tím, že jen menšina klientů je schopná problém řešit proaktivně. „Firmy můžou boty blokovat, snažit se jim zabránit v přístupu. AI boti ale mohou operovat i přes běžný prohlížeč a tvářit se jako koncový uživatel, takže jim fakticky v přístupu zabránit nejde,“ varuje.

Jak velký podíl provozu boti tvoří, naznačují data Cloudflare, největší CDN sítě na světě. Podle nich boti před rozmachem AI tvořili přibližně 20 % veškerého internetového provozu. Dnes je to již 50 % a předpoklady hovoří o tom, že příští rok provoz od botů poprvé překročí provoz od lidí.

Tento rozměr problému popisuje Alex Spector, senior solution engineer Cloudflare, který k tématu před pár dny hovořil v Praze. Firma zpracovává více než 25 miliard HTTP requestů za sekundu a vidí přes 20 % veškerého světového webového provozu. „Noví, modernější boti, používají sofistikované techniky, aby se vyhnuli detekci. Dokážou napodobovat lidské chování, používat reálné nebo headless prohlížeče, a navíc operují přes takzvané residential proxy IP adresy, tedy stejné IP adresy, jaké mají běžní uživatelé internetu. Tradiční metody jako geo-blokování nebo blokování podle user-agenta přestávají stačit,“ popisuje.

„Identifikace přístupů AI botů na váš web se liší podle provozovatele. U OpenAI to poznáte snadno, protože jejich bot se identifikuje v takzvaném user-agentu, tedy kousku textu, který přímo zmiňuje, kdo je a odkud pochází. Google své boty také identifikuje, a navíc zveřejňuje rozsah IP adres, ze kterých přistupují. Dál už ale neupřesňuje jejich použití a není tak jednoduché rozpoznat, zda se jedná o bota, který ‚krmí‘ běžný vyhledávač, nebo toho, který slouží Gemini,“ rozvádí pak Zapletal.

Zprávy pro roboty

Boti se pohybují tam, kde mohou zjišťovat informace, třeba data o produktech a jejich cenách na e-shopech, o destinacích u cestovek nebo třeba parametrech účtů v nabídkách bank. Samotný vshosting hostuje infrastrukturu Shoptetu a další velké projekty, což znamená, že když hovoří o nárůstu, hovoří o odhadem 60–70 % všech českých e-shopů, které běží v jeho datovém centru.

Další významní hráči na českém interntu ale vnímají nárůsty také. „Návštěvnost z generativních AI nástrojů v retailu, cestování a bankovnictví se od září 2024 zdvojnásobuje každé dva měsíce. To jsou čísla z Adobe Analytics, na která narážíme v práci s klienty,“ doplňuje Zapletal z Etnetery.

Upozorňuje také na skutečnost, že návštěvnost AI botů může být pro některé dobrá zpráva, protože firmě můžou přivést zákazníky. To ale platí jen ve chvíli, kdy jsou na ně tyto weby připravené. „Firmy to zatím spíš vnímají jako hrozbu pro organický traffic z Googlu než jako nový prodejní kanál, který by aktivně budovaly. Ale obě věci jsou dvě strany téhož problému,“ upozorňuje Zapletal.

Jak tedy bojovat proti robotické návštěvnosti? „V minulosti se tento typ problémů nejčastěji řešil tím, že se vytipovalo pár problémových IP adres, které se zablokovaly. Nebo se zablokoval provoz ze zemí, jako je Čína, odkud klient nemá žádné legitimní návštěvníky. Jenže teď například Cloudbot, což je aktuálně asi největší AI bot, používá infrastrukturu Amazonu. To nemůžeme blokovat, protože IP adresy, které Amazon používá, se dynamicky mění a na Amazonu jsou hostované například různé platební brány a doručovací služby, které klient používá,“ popisuje Skála.

Nechovají se přitom všichni stejně. Skála hovoří o botech „slušných“, kteří se identifikují user agentem a čtou robots.txt, který je vystavený na serveru. „Když je tam pro něj přístup zakázaný, měl by to respektovat. Reálně to však funguje tak, že si boti přečtou robots.txt, zjistí, že tam mají zakázaný přístup, ignorují ho a sbírají data dál. Ta jsou pro ně totiž tak cenná, že je jednodušší tyto zažité konvence ignorovat a web posbírat celý,“ vysvětluje Skála. Mezi slušnými boty vyjmenovává Google či Seznam, kteří mají zveřejněný seznam IP adres, odkud přistupují, identifikují se a robots.txt respektují. „Neslušný, pokud ho tak nazveme, o sobě tvrdí, že je například Chrome. A bez ohledu na zmíněný soubor web posbírá celý,“ uvádí.

Kolik jakých je, naznačuje report State of the Bots z druhého kvartálu loňského roku. Podle něj v tu dobu celkem 13,26 % requestů ignorovalo robots.txt. Na konci roku 2024 byl přitom tento podíl tříprocentní. Podle vývoje je tak zřejmě číslo aktuálně ještě vyšší. Stejný report také mimo jiné uvádí, že počet stránek blokujících AI crawlery za poslední rok narostl o 336 %.

Bot chycený v bludišti

Základní ochranou kromě placených služeb je tedy soubor robots.txt a filtrování podle user-agenta. Obě metody jsou zdarma a snadno nastavitelné, ale proti sofistikovaným botům nestačí.

Ani ti boti, kteří se vydávají za lidské uživatele, ale na webu nezapadnou. „Ve většině případů identifikujeme boty podle request headeru, případně pomocí pokročilejších technologií na Fortigate FW. Alternativou je pak použití specializovaných služeb (Cloudflare, Radware),“ popisuje Svátek z ČMIS.

„Dokážeme je identifikovat na úrovni serveru, protože se snaží tvářit jako prohlížeč. Identifikaci, což je hlavička User-Agent, posílají jako prohlížeč, ale neposílají už ostatní hlavičky, které prohlížeč posílá. Naše ochrana proti botům počítá skóre tohoto requestu. Jakmile je pravděpodobnost, že se jedná o provoz nějakého bota, a případně jej zablokuje,“ říká Skála.

Podobný přístup, tedy scoring každého requestu namísto blokování podle seznamů, popisoval také Spector za Cloudflare. Společnost vedle toho vytvořila nástroj nazvaný AI Labyrinth, honeypot speciálně navržený pro AI crawlery. „Vytváříme neviditelné odkazy, které by normální uživatel nikdy nenásledoval, ale AI bot ano – protože ignoruje tag ‚nofollow'. Jakmile bot tyto odkazy začne sledovat, generujeme další a další, takže se ocitne v bludišti a nezatěžuje reálný obsah webu,“ uvádí Spector. Systém zároveň umožňuje naučit se normální chování konkrétního webu a pak detekovat odchylky. Například pokud bot přistupuje na URL, které legitimní uživatelé nikdy nenavštěvují.