Pomáháme firmám zrychlovat weby. V posledních letech ale vidíme, že za pomalými servery často nestojí chyby vývojářů nebo podceněné železo. Stále častěji za pomalostí stojí nevyzpytatelná návštěvnost robotů.

Možná si říkáte, že stačí nastavit robots.txt nebo podobná pravidla. Bejvávalo! Z pohledu dnešních botů je to často dobrá rada, nikoliv zákon. Na jednom českém e-shopu denně blokujeme přes 600 000 dotazů od botů. Je to enormní.

Tahle nová generace automatizovaného provozu zpomaluje weby, zkresluje analytiku a vás stojí peníze. V tomto článku vám poskytnu data, která vidíme, ale také zkusím poradit, jak problémy s AI boty identifikovat a snad i efektivně řešit.

Nová generace botů. Víc provozu, víc motivace, míň respektu

Kdo dělá weby, zná boty jako své boty.

Boti se vždy zaměřovali zejména na indexování obsahu pro vyhledávače. Vy na webu poskytnete data, oni vám za to dodají zákazníky. Představili se, docela respektovali pravidla, a když jste jim řekli „sem nechoď“, poslechli. Většinou.

Podle zprávy společnosti HUMAN Security boti poprvé překonali lidský internetový provoz. Automatizovaný traffic prý meziročně roste osmkrát rychleji než ten lidský.

Cloudflare Radar sice pro Českou republiku ukazuje zatím „jen“ 17 % robotického provozu, ale pozor! Jde o průměr přes všechny weby schovanými za Cloudflare. U jednotlivých projektů, které řešíme v PageSpeed.ONE, vidíme čísla výrazně vyšší.

I staří dobří boti se činí. Crawling googlebota narostl o 96 % za jediný rok. AI boti samozřejmě rostou ještě více, protože rostou z ničeho. GPTBot od OpenAI vyrostl o 305 % a mohli bychom pokračovat.

Motivace provozovatelů botů je nyní daleko silnější. Tyhle boti sbírají data pro trénink AI modelů, pro generování odpovědí v AI (nebo správněji LLM) chatech, nebo jednají jménem uživatelů jako AI agenti.

Podle Cloudflare Radar sice tvoří uživatelské akce zatím jen asi 10 % provozu od AI, ale s rozjezdem AI agentů tohle číslo rychle poroste. Na rozdíl od stabilního trhu konvenčních vyhledávačů, kde desítky let vládl Google, zde zuří litý konkurenční boj.

Důležité je ale říct, že nejde jen o AI crawlery. Obecně roste celý automatizovaný provoz na webu. Scrapery, cenové srovnávače, monitoring konkurence, bot farmy, které vám jen chtějí sestřelit web… AI je jen nejviditelnější část problému.

Robots.txt? Jen dobrá rada, ne zákon

Soubor robots.txt je v principu prosba. Říkáte crawlerům „sem prosím nechoďte“ nebo „chovejte se tak a tak“. Jenže, jak uvádí i samotný Cloudflare, „dodržování souboru robots.txt je dobrovolné. Někteří provozovatelé robotů mohou ignorovat vaše direktivy.” Tak jasně. Tohle se děje.

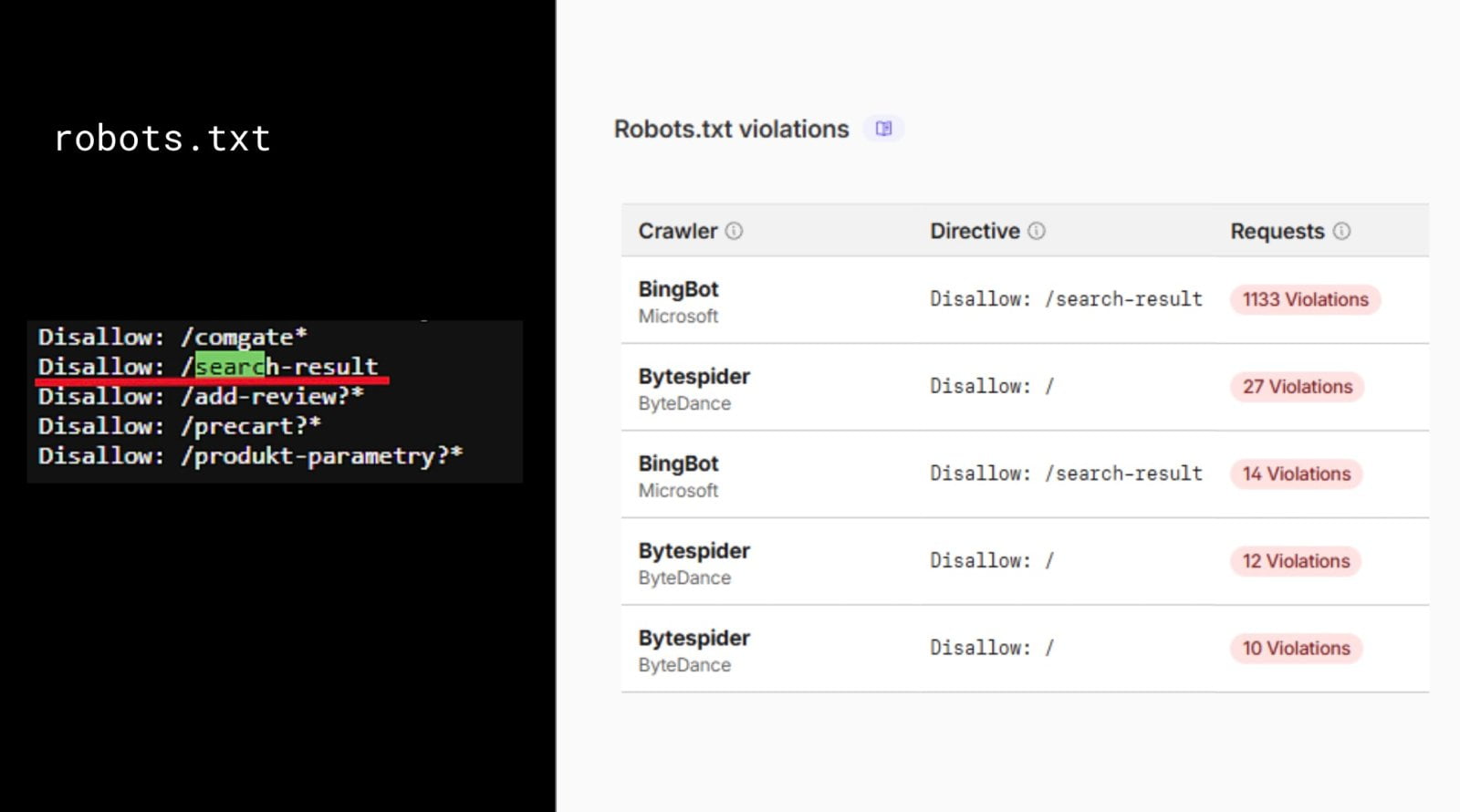

U jednoho z našich klientů, e-shopu Balistas, máme nasazenou službu Cloudflare AI Crawl Control. Ta sleduje, kteří boti porušují direktivy v robots.txt. Výsledek? Stovky porušení za pouhý týden u jediného z webů tohoto klienta.

Nastavit si správně robots.txt? Tak jasně, ale to dnešní roboty moc nezajímá. Například BingBot, robot Mety, Bytespider, ale i další, vesele crawlují stránky, které mají v robots.txt explicitní Disallow.

Tohle není výjimka. Vidíme to na dalších projektech z oblasti e-commerce i jiných webech, o které se staráme.

Crawl delay nebo IP adresy botů? Samy o sobě přestávájí fungovat

Můj kolega Tomáš Svoboda, který se v našem týmu specializuje na backend a infrastrukturu, to shrnuje: „U crawl delay vidíme stále zvětšující se rozdíl mezi teorií a praxí. V teorii by to mělo fungovat tak, že bot stáhne stránku a dá si několik vteřin přestávku, než půjde na další. Ale například Googlebot to často nerespektuje.“

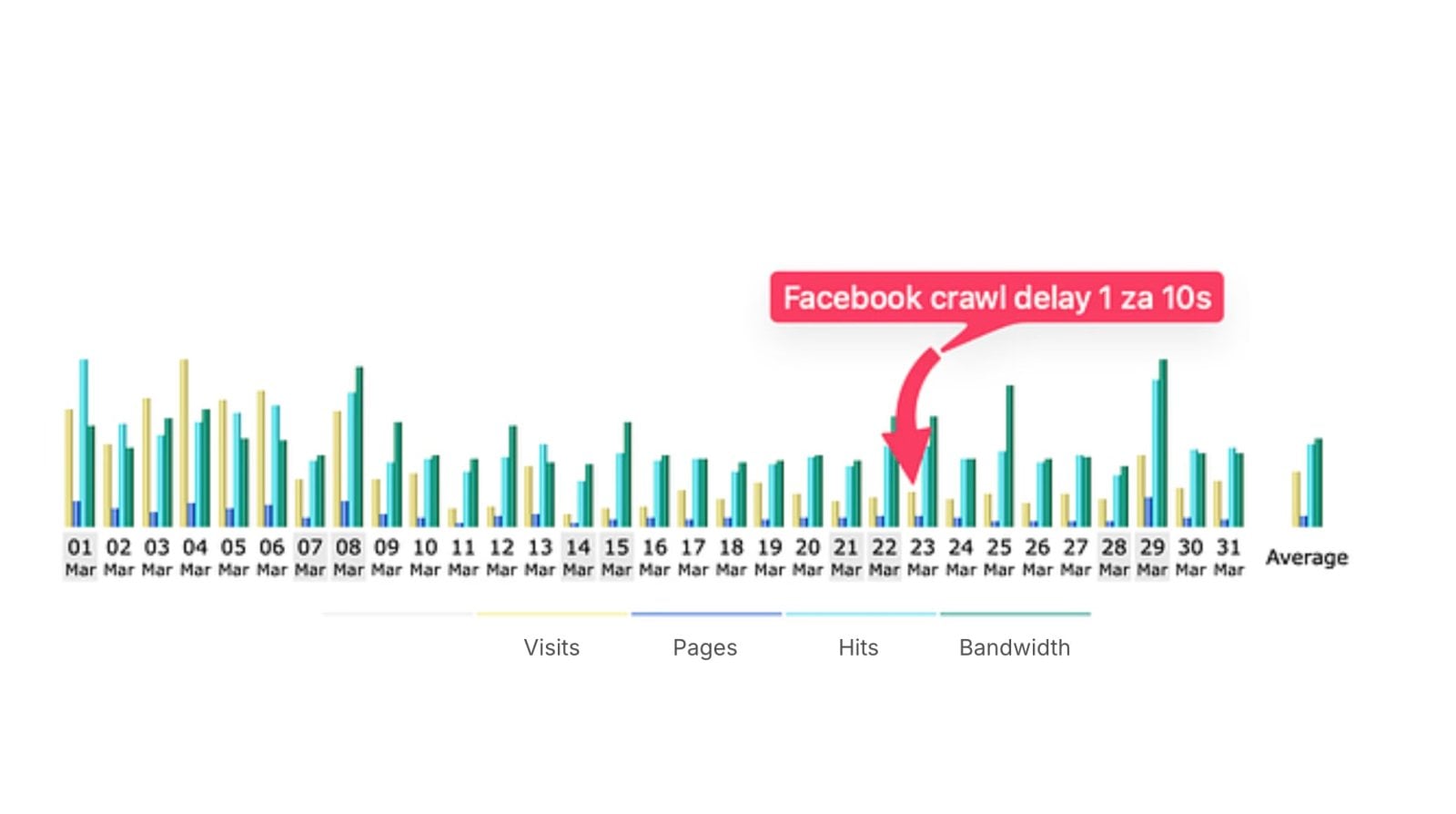

U jiného klienta, e-shopu Postel.cz, jsme zase zaznamenali, jak crawler od Facebooku nastavený crawl delay (1 request za 10 sekund) zcela ignoruje a bombarduje web bez přestávky.

A detekce botů podle IP adresy? Tomáš pokračuje: „Bot od Mety rotoval na jednom projektu 70 IP adres a za měsíc udělal na každé 100 tisíc dotazů.“ To je šest milionů requestů měsíčně od jednoho bota na jeden web. Dobře schovaného.

Boti, respektive jejich vývojáři, jsou chytří. Rotují IP adresy koordinovaně tak, aby žádná jednotlivá adresa neměla podezřele velký počet dotazů. Na malém webu jsme viděli desítky IP adres, které se systematicky střídaly.

Někdy nepomáhá ani poctivé nastavení Crawl delay. I po něm robot Facebooku prováděl 220 tisíc dotazů na stránky za den.

A pak je tu nejzákeřnější kategorie. Maskovaní AI boti. Znovu dám slovo kolegovi Tomáši Svobodovi: „AI boti se často ani nepodepíší. Maskují se, mění IP adresy a lokace, aby nešli zachytit."

Maskování není něco, co vidíme jen my. Cloudflare loni publikoval detailní analýzu, jak Perplexity, jeden z AI startupů, používá nedeklarované, „stealth“ crawlery, které se záměrně vyhýbají direktivám zakazujícím procházení webů.

Jak to celé pak vypadá v praxi a na číslech? Na e-shopu Balistas (10 jazykových mutací) denně blokujeme přes 600 000 dotazů od botů. Jak říká CMO Balistas, Marek Adamkovič: „To, co dříve řešily opravdu velké projekty, dnes dopadá i na střední a menší hráče. Nová realita e-commerce.“

Ale pozor, nestačí prostě jen blokovat. Nechcete totiž přijít o přínosnou část provozu botů.

Jednorázové peaky návštěv, kampaň to není

Traffic z botů není rovnoměrně rozložený v čase. Vidíme něco, čemu interně říkáme „šílení botů“.

Jde o krátké, intenzivní vlny, kdy bot pošle obrovské množství requestů najednou. Právě na e-shopech Balistas dokáže bot od Mety „vykouzlit“ až na 510 000 dotazů za den na jednu jazykovou mutaci.

Zhruba 6 requestů za sekundu, nepřetržitě. Božínku, to už není crawling, to je skoro DDoS.

Má to ale vliv na jednu věc, o které se v souvislosti s boty zase tak moc nemluví a o kterou se našim klientům staráme. Rychlost vašeho webu pro návštěvníky.

Proč je to problém? Protože rychlost = peníze

Když boti přetíží váš server, web se zpomalí pro všechny, tedy i pro vaše zákazníky. A pomalý web bolí víc, než si většina lidí myslí.

Přetížený server znamená vyšší dobu odezvy (tedy zhoršení metriky TTFB, Time to First Byte), což se okamžitě promítne do uživatelských metrik, které Google sleduje v rámci sady Core Web Vitals.

Horší metriky, pak značí horší pozice ve vyhledávání, horší uživatelský zážitek a nižší konverze. Studie Deloitte Digital ukázala, že každých 100 milisekund zrychlení webu může přinést:

- + 5,2 % shlédnutí stránek na session

- + 8,4 % na konverzním poměru

- + 9,2 % na průměrné hodnotě objednávky

My jsme si zase v praxi ověřili vliv Core Web Vitals na SEO, když se nám optimalizací povedlo zvýšit e-shopu deNatura návštěvnost z Googlu o 17 %.

Rychlost prostě není jen IT metrika, je to součást byznysu vašeho webu.

A tady vzniká další paradox. Vy (doufám!) investujete do optimalizace rychlosti, ladíte frontend, řešíte obrázky a skripty, a pak vám boti zatíží backend tak, že se to celé sesype jako domeček z karet. Třeba během Black Friday, což se jednomu za naši klientů stalo.

K tomu přičtěte další problémy:

- zkreslenou analytiku (provoz botů v Google Analytics není vždy správně odfiltrovaný)

- vyšší náklady na hosting (vytížený server = potřeba silnějšího železa)

- občasné výpadky dostupnosti, kdy web prostě přestane odpovídat

Už jsem vás přesvědčil, že tomuto tématu se na vašich webech máte věnovat? Pojďme si teď říct, co se s tím dá dělat.

Jak poznat, že je to i váš problém?

Nejzákeřnější na tom celém je, že to nemusíte vůbec vědět. Web je pomalý, ale ne tak, že to vidíte vy sami v prohlížeči.

Někdy je pomalejší jen o trochu, někdy jen v určité hodiny a někdy jen pro určité návštěvníky. Standardní nástroje jako Google Analytics nebo Google Search Console vám to samy od sebe neřeknou. Říkáte si možná: návštěvnost neroste, tak proč by měl být server vytížený?

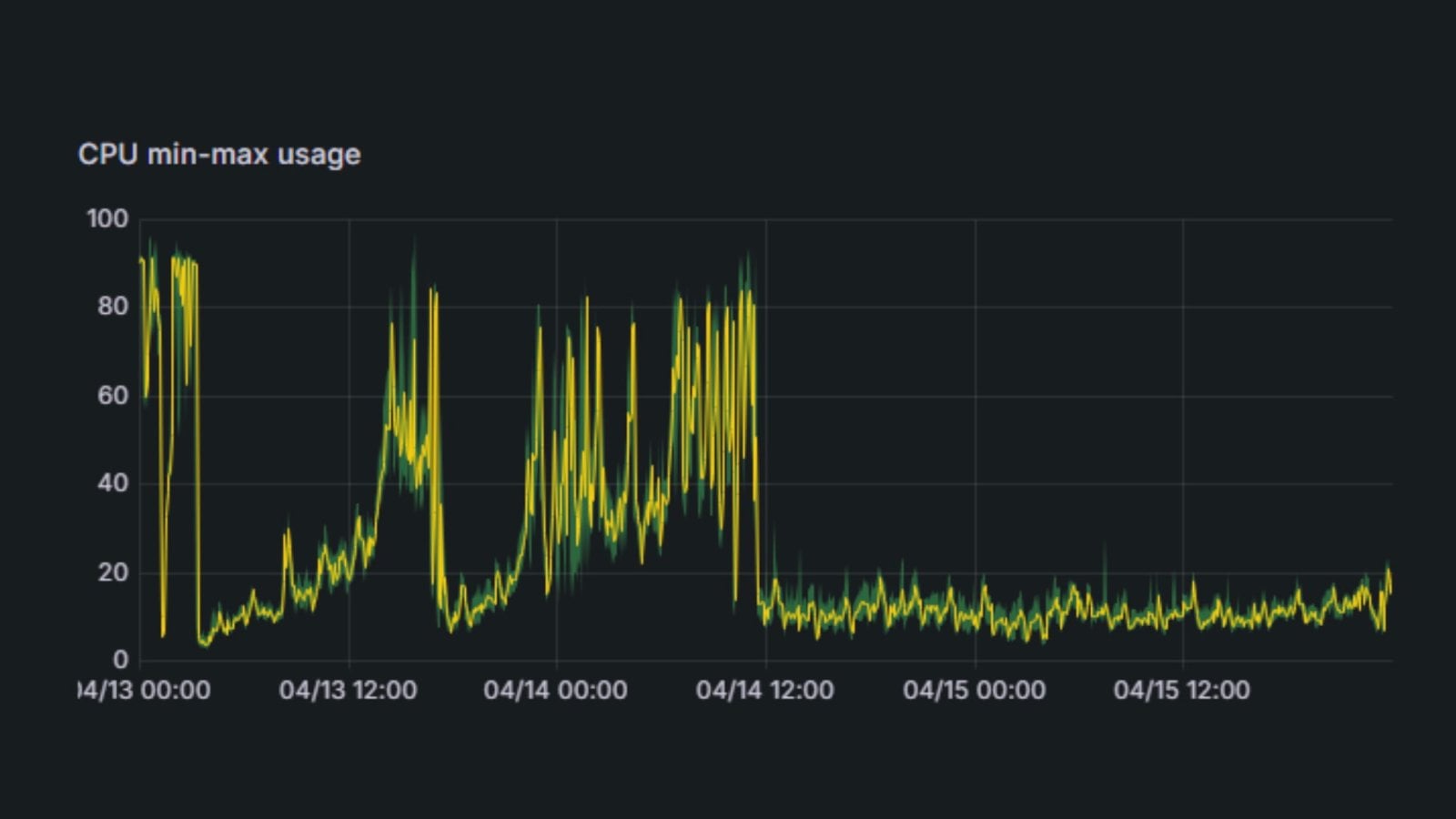

Typický scénář z naší praxe: U jednoho z velkých českých e-shopů jsme viděli, jak CPU serveru pravidelně naráželo na 100 % hranici. Odehrává se přitom žádná špička návštěvnosti od lidí, žádný deployment, žádná kampaň. Servery prostě nestíhaly a web se zpomalil natolik, že ho tým musel v pátek ve dvě ráno nouzově restartovat. Nevím jak vy, ale já bych tohle řešit nechtěl.

CPU min-max usage. Špičky na 100 %, ale bez korelace s lidskou návštěvností.

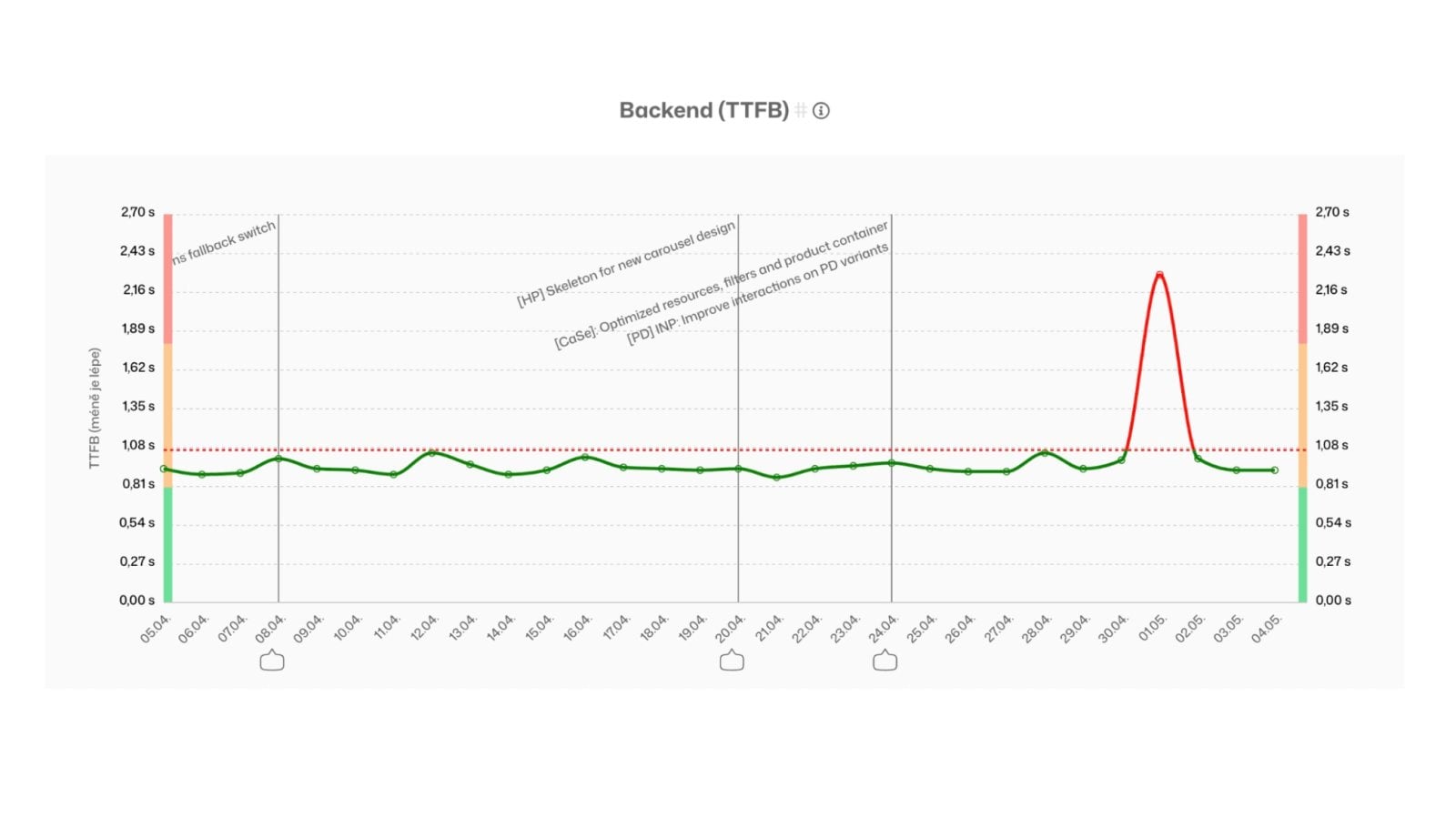

Podívejte se na graf odezvy serveru (TTFB) z monitoringu rychlosti toho samého projektu. Metrika vyskočila z běžných hodnot na trojnásobek. A to v době, kdy lidský traffic nic zvláštního neukazoval.

Náhlé zhoršení TTFB bez špičky návštěvnosti? Nebyli to boti?

Na co si tedy musíte dáte pozor?

- Zpomalení webu mimo špičky návštěvnosti.

Pokud je váš web pomalý večer, v noci nebo o víkendu, kdy lidé tolik nenakupují, zpozorněte. Může jít o signál silného provozu botů. - Nárůst TTFB bez zjevné příčiny.

Backend náhle odpovídá pomaleji, nic jste neměnili. Raději zpozorněte a ujistěte se, zda máte data o provozu botů na vašem serveru. - Nedostupnost webu.

Dějí se vám občasné výpadky, které nekorelují s ničím ve vašem deploy kalendáři nebo návštěvností. Vývojáři a experti na vaší infrastrukturu se diví? Opět možný signál, že boti „šílí“. - Rostoucí náklady na hosting.

Čím vytíženější server, tím víc ho potřebujete škálovat. A zde platíte za kapacitu, kterou spotřebovávají boti, ne vaši zákazníci.

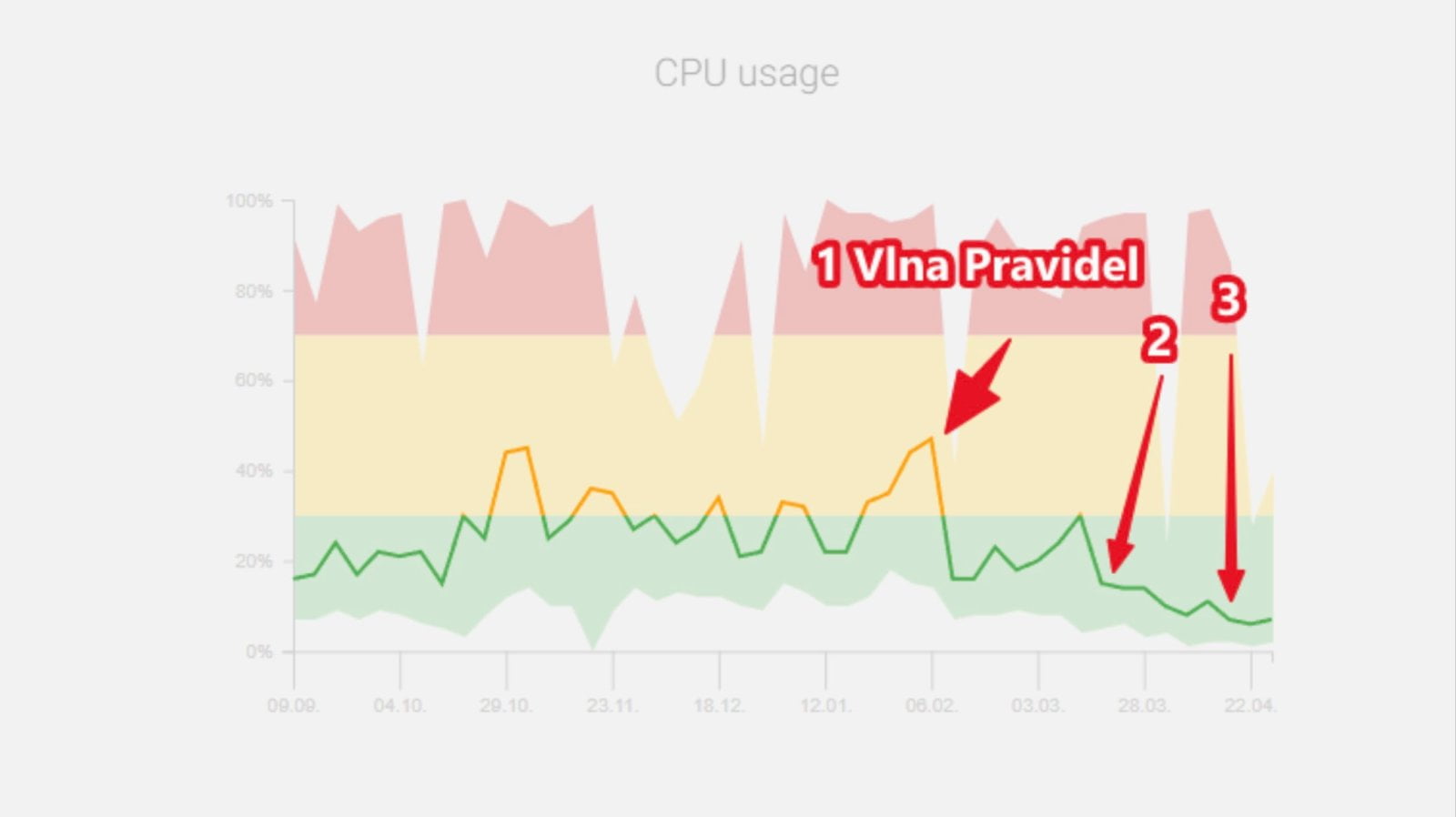

U jednoho klientského projektu jsme po nasazení pravidel v Cloudflare viděli postupný pokles využití CPU serveru. Z trvale přetíženého stavu na zdravé hodnoty.

Omezení botů někdy nefungují samy o sobě, ale v chytré kombinaci se jim stále daří. Zde například každá vlna pravidel (filtrace botů, rate limiting, geo-blocking) srazila zátěž o další kus:

Postupný pokles vytížení CPU po nasazení vln pravidel v Cloudflare.

Co s tím? Strategie, ne jednorázovka

Důležité je říct na rovinu: tohle se nevyřeší jedním nastavením a hotovo.

Boti se mění, jejich chování se vyvíjí, nové crawlery přibývají každý měsíc. Na Balistas, ale i na dalších projektech, to s naší pomocí ladí dlouhodobě. Prakticky každý měsíc něco upravujeme. Jak říká Marek Adamkovič: „Nastavit → sledovat → upravit → znovu. Je to dlouhodobá hra."

Na druhou stranu, nějaké základní kroky může udělat každý a výsledky uvidíte rychle. Čím začít?

- Podívejte se na monitoring rychlosti webu.

Porovnejte špičky metriky TTFB se špičkami návštěvnosti. Pokud se neshodují, máte pravděpodobně problém s boty. Můžete použít třeba náš monitoring nebo jakýkoliv jiný. Monitoring vám silně doporučuji i kvůli jiným důvodům. Případně si udělejte alespoň rychlý test rychlosti webu u nás nebo v PageSpeed Insights. - Nasaďte Cloudflare nebo podobnou službu.

I základní verze zdarma vám do jisté míry pomůže. Cache sama o sobě obslouží klidně až kolem 40 % provozu a odlehčí vašemu serveru. Základní blokování botů tam také je. - Zeptejte se svého hostingu na ochranu před boty.

Boj s crawlery samozřejmě vedou i české a slovenské hostingové společnosti. Více či méně úspěšně. Zeptejte se, jak to řeší, a chtějte data pro svůj web.

Pokud jste více techničtí, můžete si pomoci do nějaké míry sami. Checklist vypadá asi takto:

- Analyzujte access logy, GA4 a Google Search Console.

Hledejte anomálie v trafficu, neobvyklé user-agenty, traffic z podezřelých regionů. - Nasaďte WAF (Web Application Firewall).

A také rate limiting na úrovni Edge/CDN. Robots.txt je fajn, ale nebude vám to stačít. Potřebujete nástroje, které pravidla skutečně vynucují. - Řešte bot management.

Například Cloudflare AI Crawl Control, Bot Fight Mode nebo obdobné nástroje od jiných poskytovatelů. Cílem je mít přehled o tom, kdo na váš web chodí, a umět reagovat. - Volte strategický přístup.

Nevypínejte boty plošně, rozmyslete si vaši strategii. Googlebota potřebujete, některé AI crawlery vám mohou přinášet traffic z AI vyhledávačů. Filtrujte, limitujte, reagujte na aktuální stav.

Jaká legrace nás s AI boty čeká do budoucna?

Strategie pro práci s AI boty je živé téma. Autoři crawlerů jsou kreativní a trh na to reaguje novými přístupy a nástroji. Zde je několik témat, která v PageSpeed.ONE sledujeme:

- Markdown pro agenty.

Cloudflare nedávno představil Markdown for Agents, který botům servíruje lehkou verzi obsahu v Markdownu, namísto plného HTML. Méně zátěže pro server, bot dostane co potřebuje. Krásný nápad. Podobně funguje llms.txt, tedy soubor, který AI crawlerům říká, kde na webu najdou to podstatné. - JS fingerprinting.

Moderní metoda detekce botů, která analyzuje, jak se klient chová na úrovni JavaScriptu. Boti se ještě stále neumějí chovat tak, jako uživatelé v prohlížečích. - Behaviorální analýzy.

Pokročilejší verze stejného principu. Sem patří i nástroje jako Cloudflare Turnstile nebo reCAPTCHA v4, které místo otravných obrázků s přechody pro chodce analyzují chování uživatele v pozadí.

Pojďme si to téma shrnout. Web crawlery tu byly vždycky a budou tu dál. Bude to s nimi spíše horší než lepší, s tím nic nenaděláme. Éra, kdy stačilo mít rozumný robots.txt a dál se o boty nestarat, je nenávratně pryč, a to i menší nebo středně velké weby.

Musíme se na webu naučit žít s novou generací automatizovaného provozu. Agresivnější, chytřejší a s úplně jinou motivací než staré dobré indexovací boty.

A pokud se o své weby staráte (a věřím, že ano, když čtete Lupu), je čas tohle začít řešit.