To je všude samá Nvidia, ale trh s čipy pro trénování a pohon takzvané umělé inteligence postavené na velkých jazykových modelech je mnohem bohatší. Nedávno jsme například na Lupě ukazovali čipy Trainium a Inferentia od Amazon Web Services, které rychle získávají trakci. Doplňují je procesory Graviton, které obecně v AI hrají silnou roli, protože jsou potřeba pro AI agenty nebo inferenci. Meta si má pronajmout miliony Gravitonů. Své čipy v cloudu provozuje také Google, který před pár dny přišel s jejich zřejmě největší aktualizací.

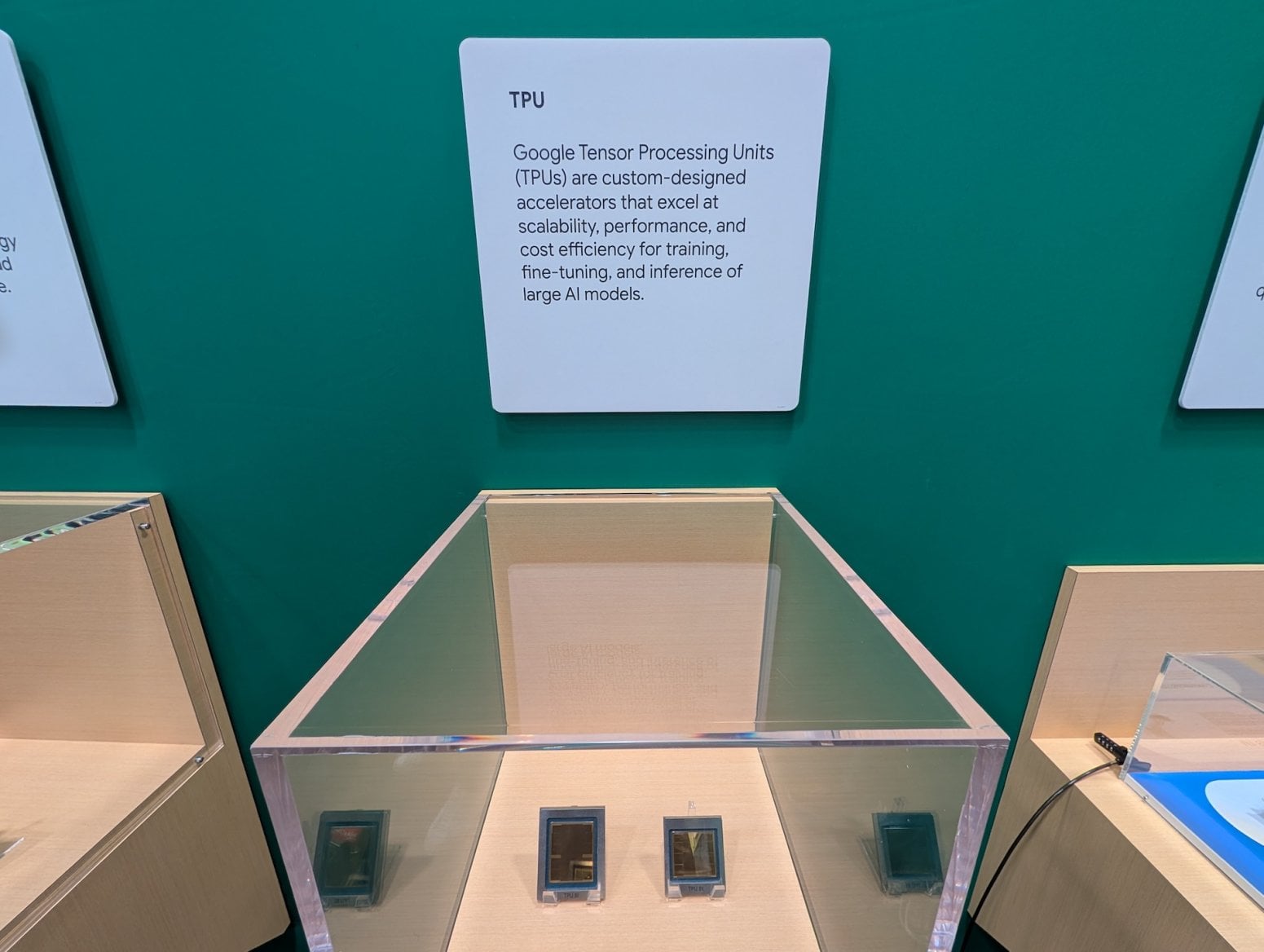

AI čipy od Googlu mají označené Tensor Processing Unit neboli TPU. Firma je v rámci Google Cloud Platform nabízí už několik let. Na jejich základě vznikla i řada softwarových technologií, nejslavnější je zřejmě TensorFlow, jeden z nejdůležitějších frameworků pro strojové a hluboké učení. Google na TPU vytrénoval a provozuje modely Gemini 3 a novější a nabízí je i v běžných instancích.

TPU nejsou to samé jako GPU, tedy zjednodušeně řečeno grafické karty od Nvidie a AMD. GPU je univerzální čip, který lze díky nástrojům typu CUDA různě programovat a instruovat. TPU je ASIC, který má jasně “zatavené” obvody určené pro násobení velké matice čísel, což je vhodné pro AI. TPU díky tomu může být značně efektivní, ale funkčně omezený (specializovaný).

Dostatek HBM

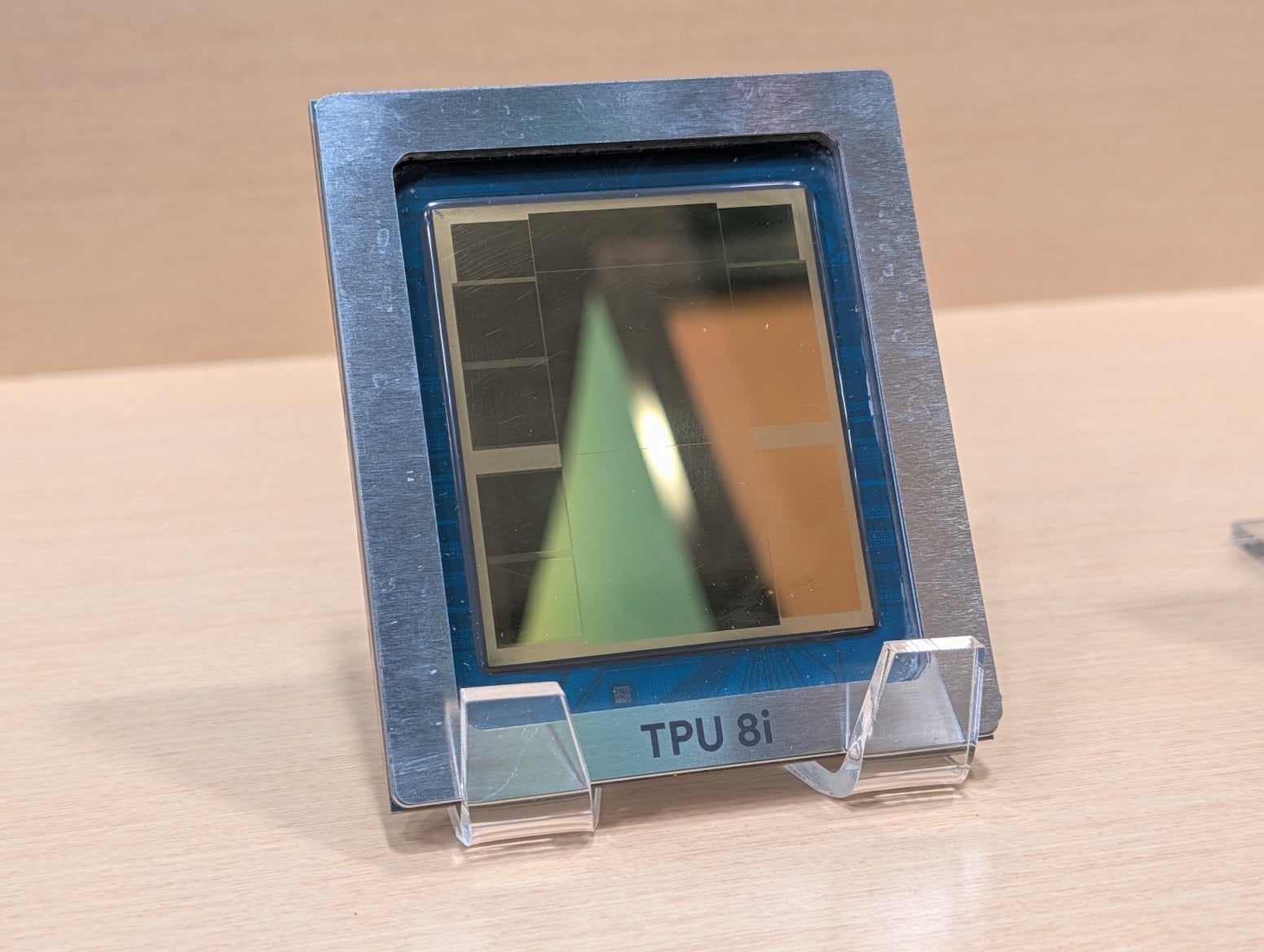

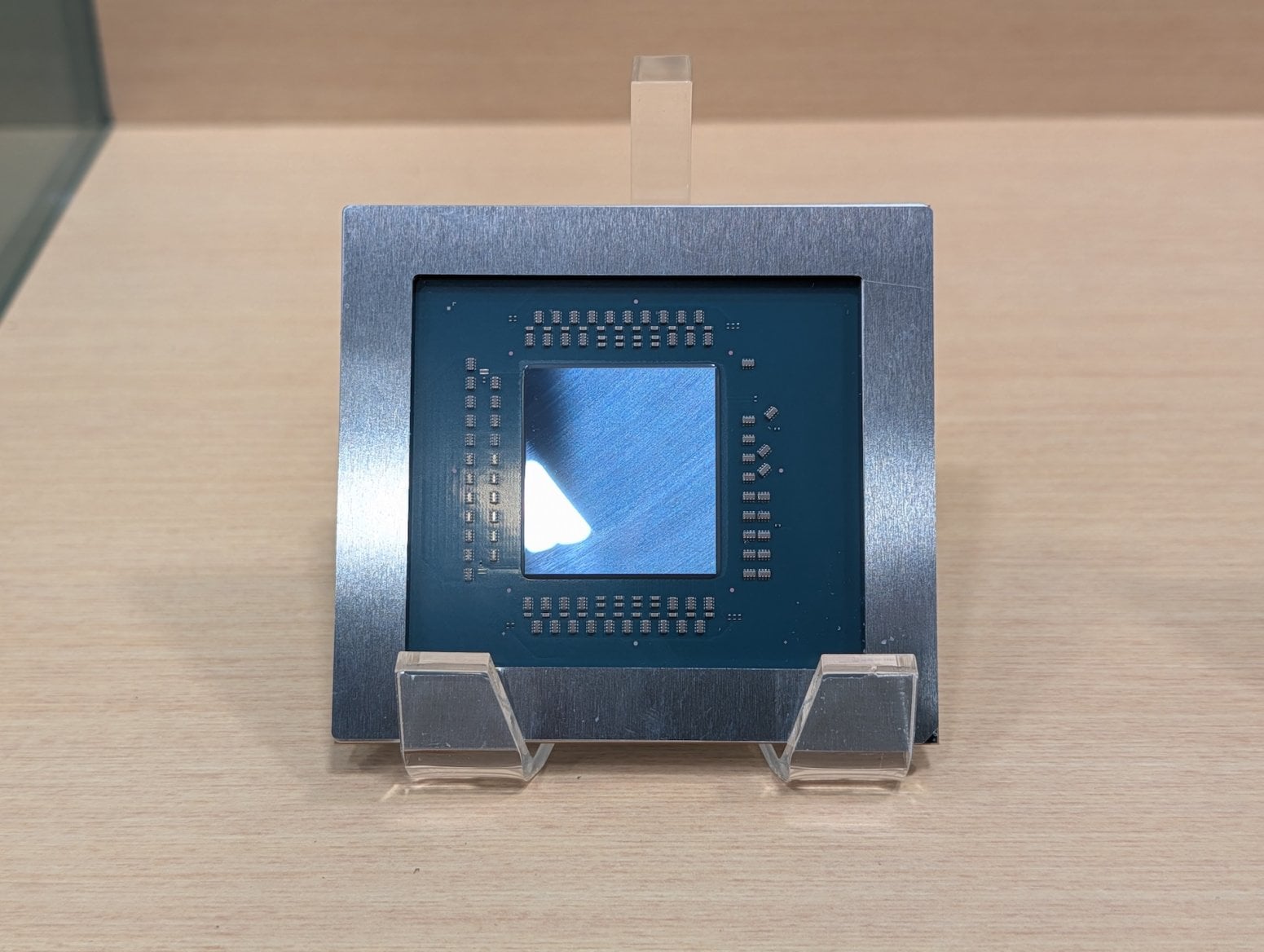

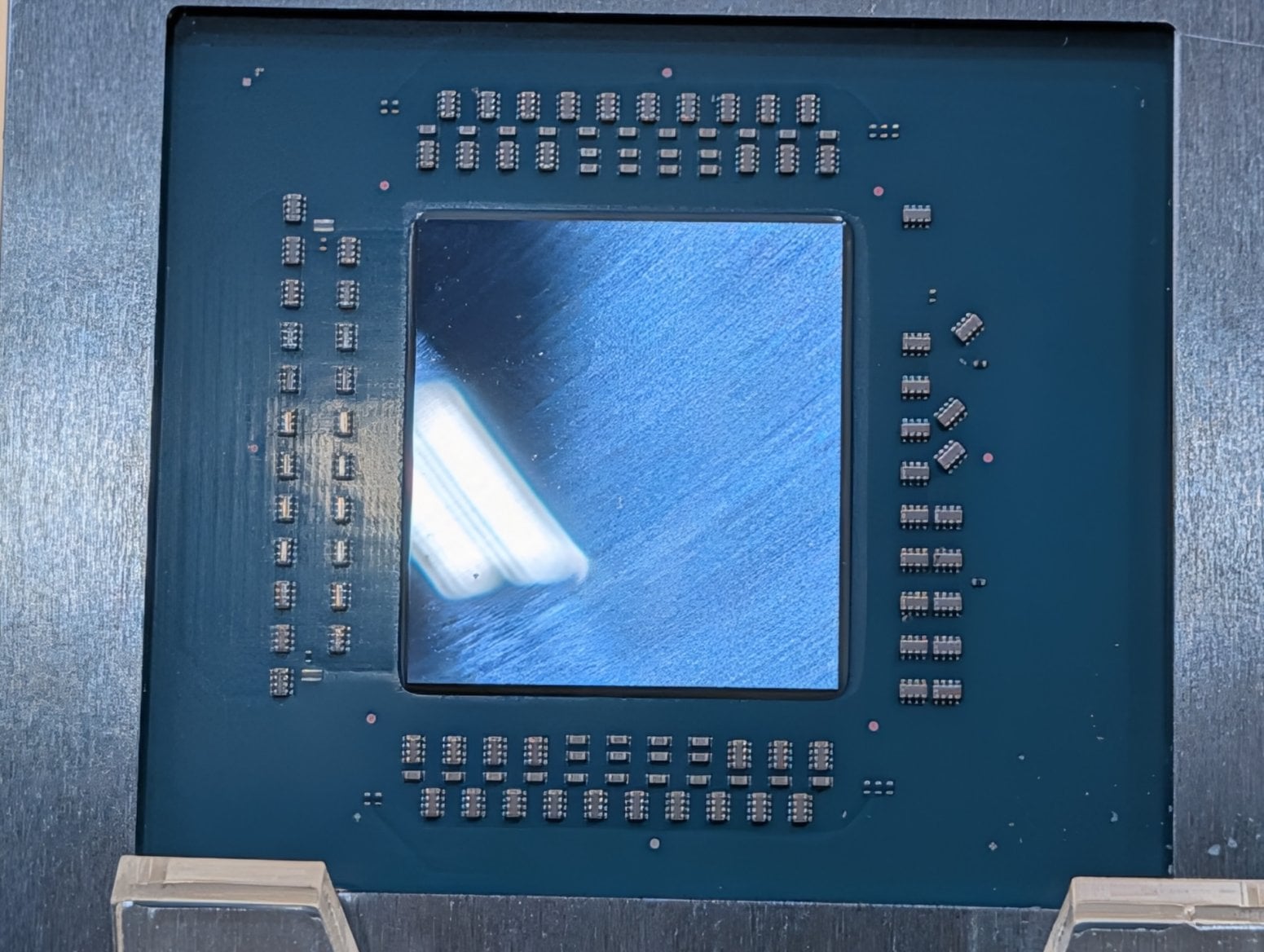

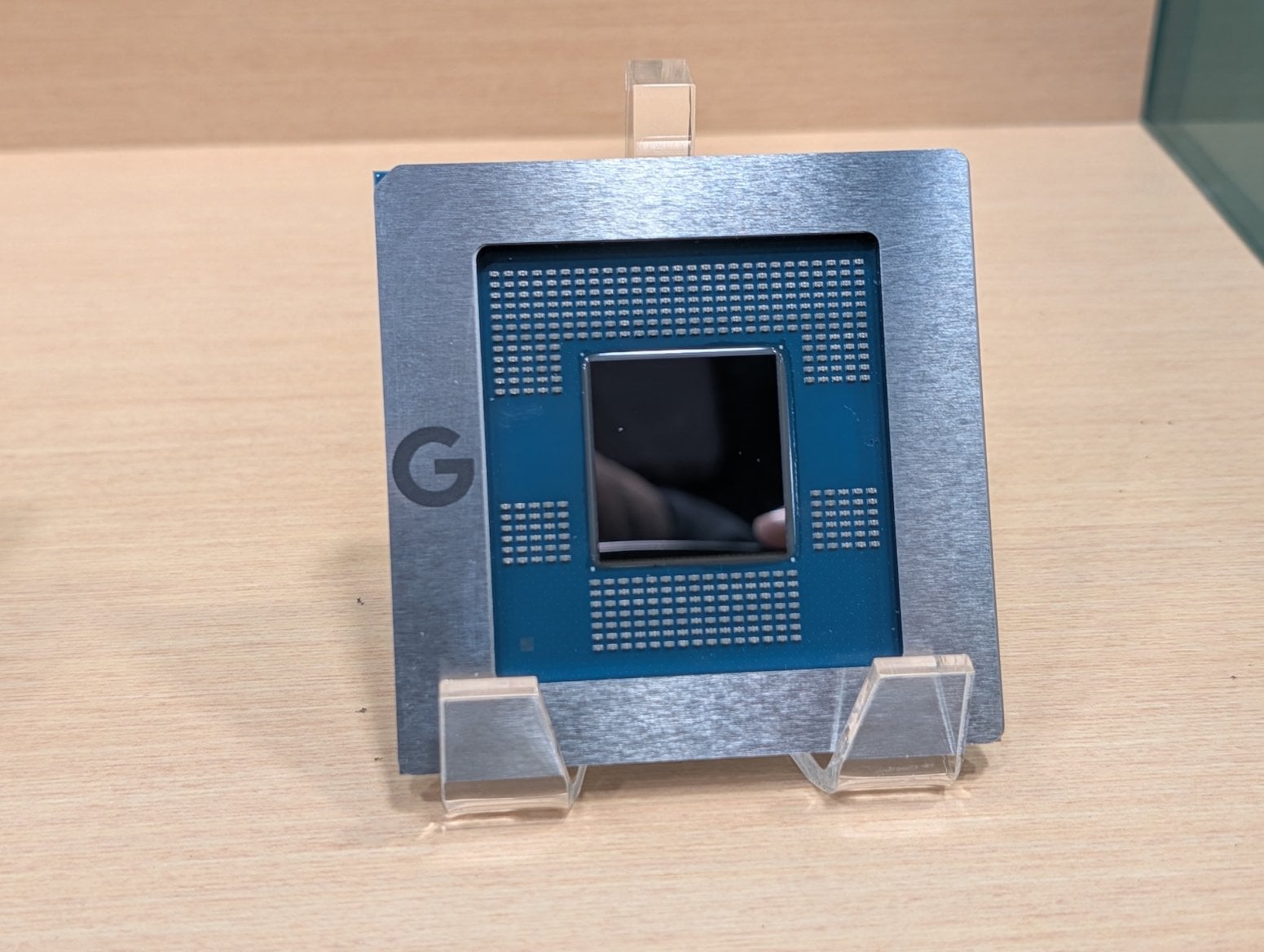

TPU nyní dorazilo v osmé verzi s tím, že Google TPU rozdělil na dvě verze. TPU 8t slouží pro trénování a TPU 8i pro inferenci. Oba modely se skládají do serverových racků (podů), které se následně spojují v rámci datových center pro co největší škálu umožňující velkou výpočetní sílu. Na oba kusi se můžete podívat v naší galerii.

Každý TPU 8t obsahuje 216 GB paměti HBM3E, což jsou velmi rychlé kusy, kvůli kterým dnes mámě paměťovou krizi způsobenou odběrem do AI čipů a nedostatkem výrobních kapacit pro koncové trhy. Propustnost paměti činí 6,5 TB/s. Výkon v FP4 dosahuje až na 12,6 petaflops.

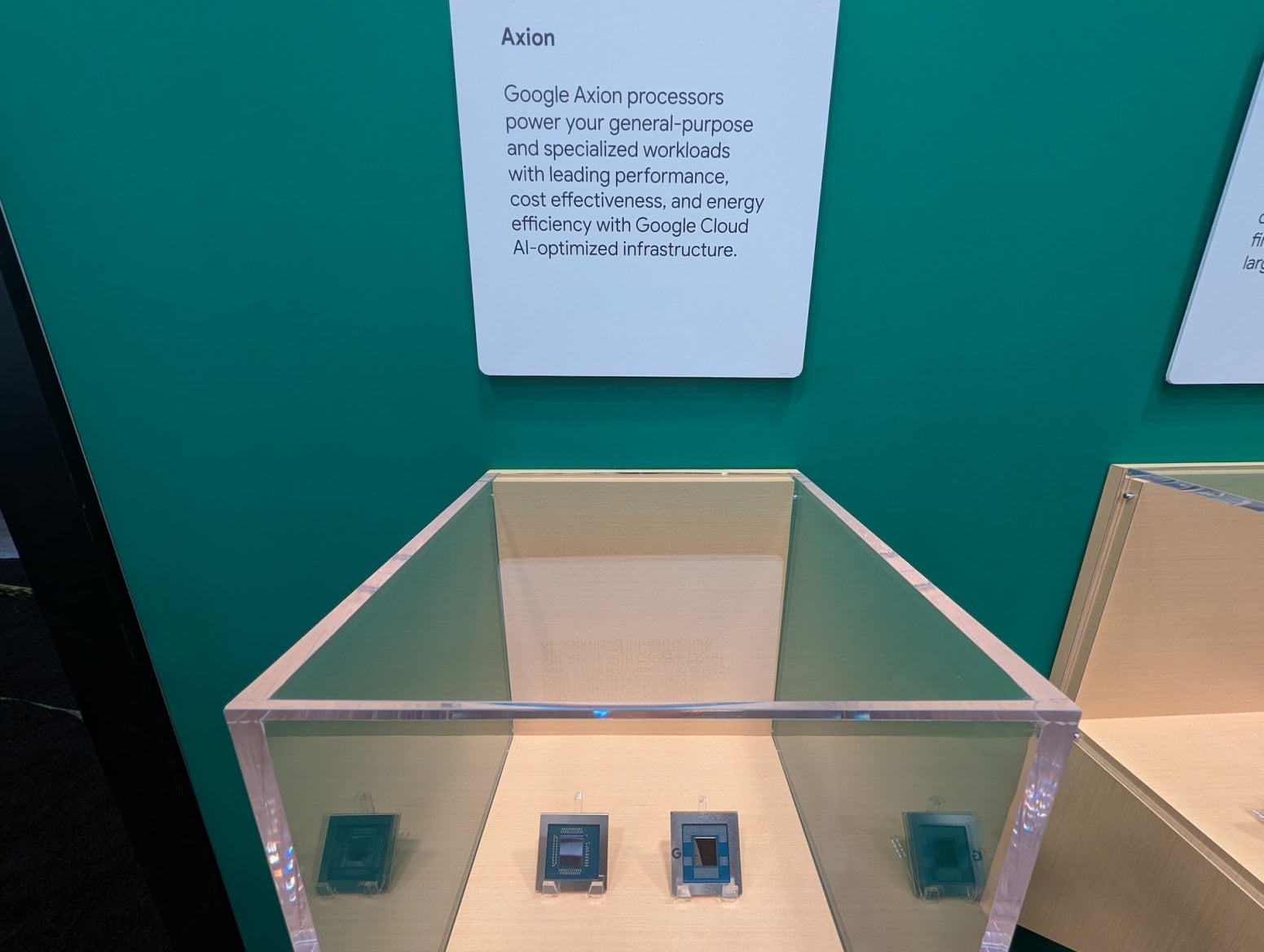

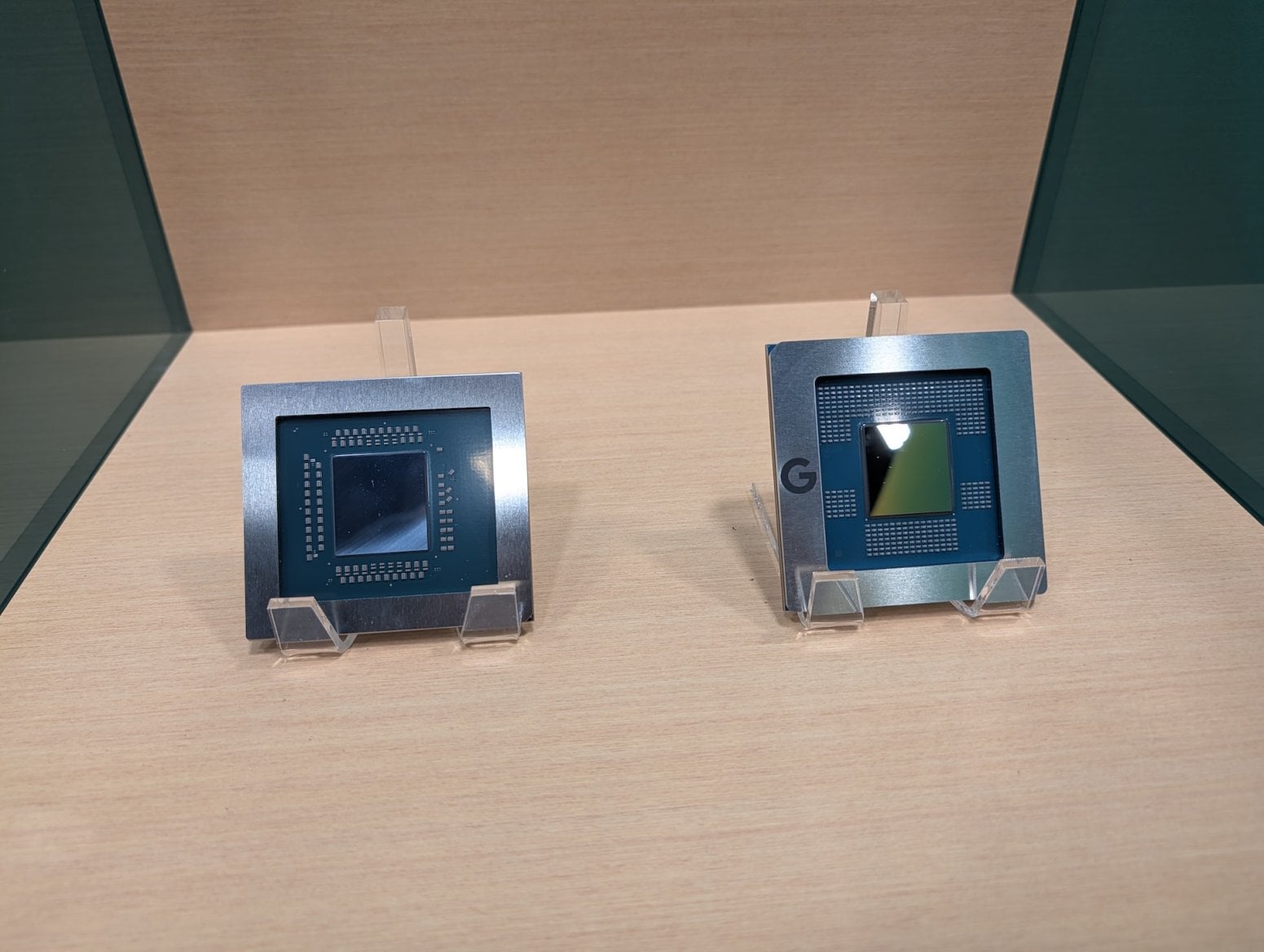

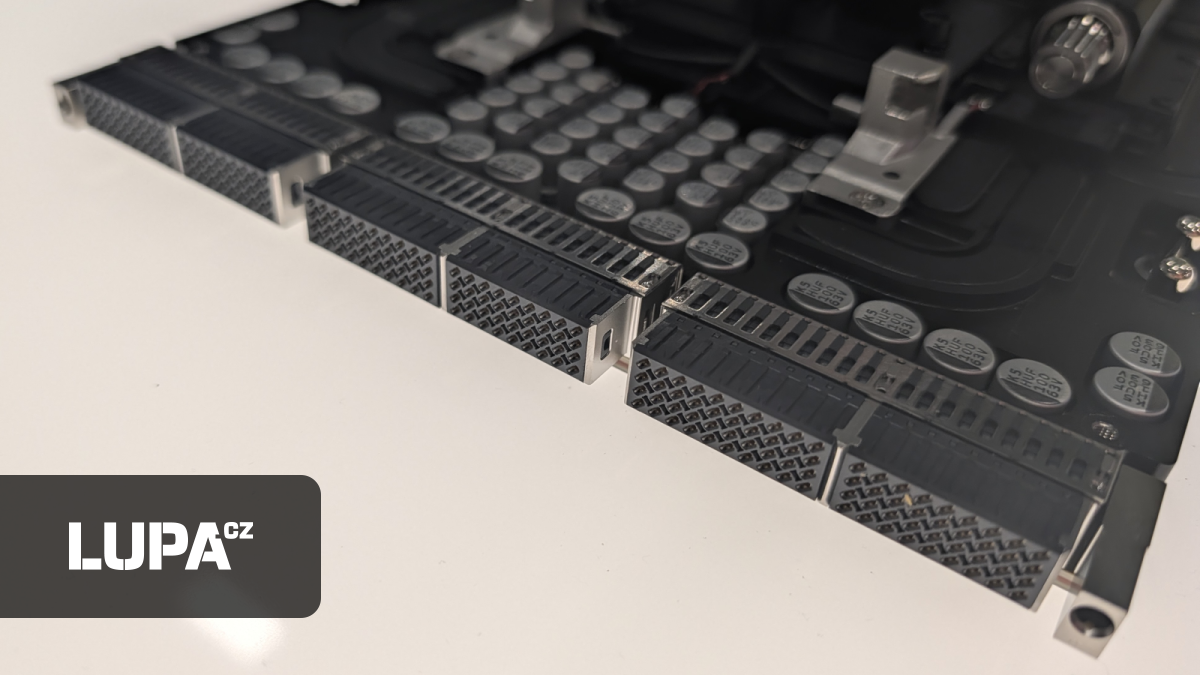

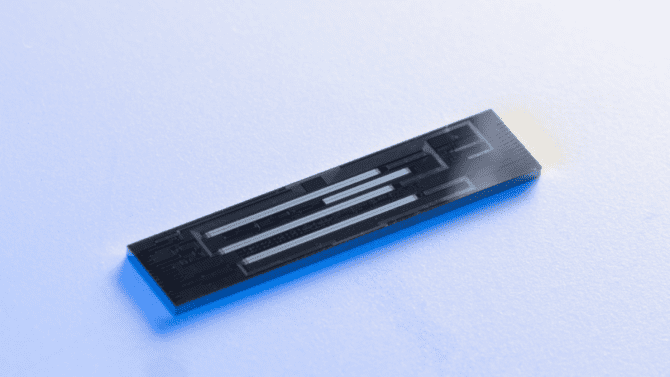

Jak vypadají čipy TPU 8t, 8I a Axion:

Do jednoho podu lze instalovat až 9 600 těchto čipů, takže lze dosáhnout na výkon v FP4 až 121 exaflops. Čipy spolu komunikují pomocí propojení s rychlostí 19,2 Tb/s (chip-to-chip bidirectional). Každé TPU 8t obsahuje jádra SparseCore pro embeddingy a jednotky pro násobení matic (MXU). Pody lze dále spojovat a vytvořit cluster o jednom milionu TPU.

TPU 8i má 288 GB paměti HBM3E, propustnost je až 8,6 TB/s. Na jeden pod lze mít až 1 152 kusů TPU s celkovou kapacitou 331,8 TB paměti. Výkon dosahuje 11,6 exaflops na pod při FP8.

Důležitost SRAM poroste

Obě nová TPU vedle HBM3E disponují také SRAM, což jsou velice rychlé paměti vhodné pro bleskovou inferenci a zpracování dat. TPU 8t má 128 MB SRAM a 8i dokonce 384 MB SRAM.

Pojem SRAM bude v umělé inteligenci čím dál více skloňovaný. Uživatelé nechtějí při komunikaci s AI čekat a zároveň je nutná rychlá odezva AI agentů. HBM je sice velmi rychlá paměť, ale ne tolik. SRAM se tak čím dál více používá jako jistý druh cache.

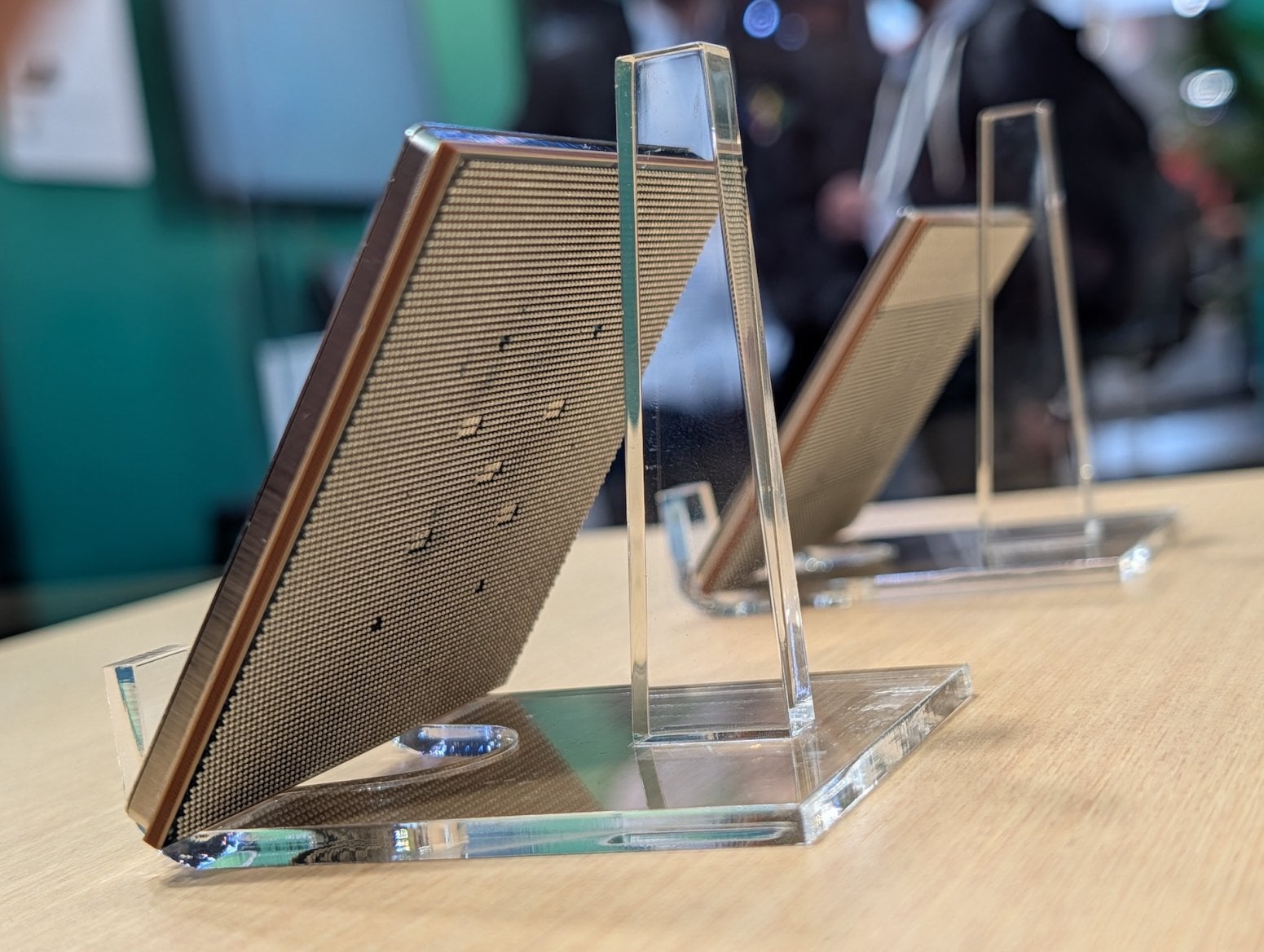

TPU rack Googlu (starší generace Ironwood):

Na trhu je kolem SRAM živo, Nvidia například v podstatě koupila Groq (20 miliard dolarů) a z jeho LPU udělala součást nabídky nadcházející generace Vera Rubin. Pak jsou zde věci jako Cerebras.

Bill Jia, jeden z hlavních autorů AI v Googlu, Lupě řekl, že role SRAM v budoucnu poroste. Zatím zřejmě na urychlení “prémiových” funkcí s postupným růstem do více oblastí.

AI hyperpočítač

Google si s příchodem TPU osmé generace vymyslel nový název pro clustery, v rámci nichž jsou poskládány – jde o takzvaný AI hyperpočítač. Názvosloví není tak důležité, zajímavé je ovšem poskládání komponent. U Nvidie známe věci jako NVLink, Mellanox nebo InfiniBand. Google s novými TPU přišel s vlastními postupy, které řeší to, jak jednotlivé čipy a pody spojovat do velkých celků. V éře AI není výkon definován čipem, ale celou infrastrukturou datacentra.

Zaprvé je zde Virgo Network, pomocí níž je možné propojit 134 tisíc TPU v rámci jednoho datacentra a milion celkově. Pro trénink AI je potřeba posílat data na hromadu čipů a právě komunikace mezi nimi bývá největší úzké hrdlo. Virgo je technologie pro Optical Circuit Switched Fabric, která odstraňuje několik vrstev přepínačů. Využívá se hostitelská vrstva (TPU) a optické přepínače spojující libovolné dva body v síti. Díky využití optiky se pracuje s nízkou latencí a za chodu je možné měnit konfiguraci. Architektura je popsána zde.

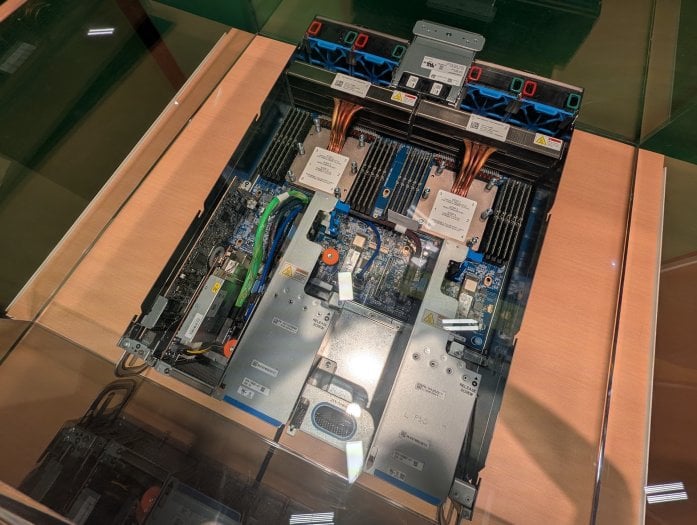

Ukázka serverů Googlu:

A zadruhé je zde Boardfly sloužící pro spojení čipů v rámci jednoho podu. Boardly už nepoužívá systém mřížky jako dříve, kdy spojení vyžadovala hodně hopů a docházelo ke zpoždění. Boardfly pracuje s hierarchií a místo mřížek používá systém zkratek. Čipy jsou připojeny na sousedící čipy, ale mají i přímé linky na vzdálenější kusy. Výpočetní uzly jsou rozděleny na logické skupiny. Bližší popis je tady.

Součástí nové generace TPU jsou také technologie TPU Direct RDMA a TPU Direct Storage. RDMA umožňuje přímý přenos dat mezi pamětí a síťovými kartami (NIC), takže není třeba zapojovat procesor a RAM, což má pozitivní vliv na odezvu. Direct Storage nabízí přímý přístup k paměti mezi TPU a storage.

Vlastní CPU a zapojení DeepMindu

Google ve spojení s oběma druhy TPU 8 používá i vlastní procesory Axion postavené na ARMu. Google uvádí, že pro účely operací s AI dosahuje dvakrát vyššího výkonu než u instancí s x86. Ostatně Graviton od AWS je rovněž ARM a Nvidia vedle serverů s Intelem či AMD nabízí i vlastní procesory rovněž na ARMu. CPU obecně budou v dalším rozvoji AI důležitá. Procesory jsou potřeba pro inferenci a agenty, což už je vidět na růstu tržeb a akcií Intelu a zprávách o postupném zdražování a možných nedostatcích. Trh má vyrůst až o vyšší desítky miliard dolarů.

Google své čipy navrhuje společně se sekcí DeepMind, díky čemuž je může ladit na míru modelům a AI operacím. Podle zástupců společnosti je výhodou to, že Google provozuje kompletní stack, tedy čipy, servery, datacentra i samotné modely. Podle Thomase Kuriana, ředitele Google Cloudu, je progres značný a měsíce tréninků lze nyní zkrátit na týdny.

I když se z Googlu stal významný konkurent Nvidie, byznysové spojení obou firem je velmi úzké. Jde o klasický pojem frenemy. Google Cloud bude jeden z prvních, kde poběží generace Vera Rubin NVL72, což jsme více rozebírali zde. Google provozuje i Blackwelly, jeden rack podepsal sám Jensen Huang.